Les controverses sur la façon dont les ensembles de données forment les outils d'intelligence artificielle (IA) ont rendu le public méfiant à l'égard de l'IA.

Une perception courante est que l'IA collecte toutes les informations qu'elle peut trouver en ligne pour entraîner ses algorithmes, au mépris de la vie privée des individus et des exigences des lois sur la protection des données.

Les scandales publics - tels que l'utilisation illégale de Facebook par Clearview AI - ont placé les plateformes de médias sociaux au premier plan des préoccupations du public concernant l'IA et la confidentialité des données.

Dans cet article, j'explique comment les outils d'IA générative sont formés et comment les données accessibles au public peuvent être utilisées dans le cadre du processus en respectant certaines exigences juridiques et techniques.

- Qu'est-ce que l'IA ?

- Comment les modèles d'IA sont-ils formés ?

- Les différents types de données utilisées pour entraîner l'IA

- La formation à l'IA à l'aide de données publiques est-elle autorisée par les lois sur la protection de la vie privée ?

- Les plateformes de médias sociaux peuvent-elles utiliser vos données pour former l'IA ?

- Résumé

Qu'est-ce que l'IA ?

L'intelligence artificielle (IA) désigne les machines capables d'exécuter des fonctions semblables à celles de l'homme.

Il existe différents types d'IA, par exemple :

- L'IA faible exécute une gamme étroite de fonctions basées sur des modèles fixes qu'elle a été programmée pour détecter.

- L'IA forte exécute des fonctions complexes en trouvant ses propres modèles dans un ensemble de données, un peu comme si elle avait un "esprit" propre, et peut continuer à apprendre de manière autonome.

Bien sûr, contrairement aux humains, l'IA n'a pas d'esprit comme vous et moi. Elle s'appuie plutôt sur les types d'ensembles de données qui lui sont fournis.

En outre, contrairement aux humains, l'IA peut détecter des modèles dans des quantités gigantesques d'informations, ce que nous ne pouvons tout simplement pas faire.

Il utilise ces modèles pour remplir sa fonction principale.

Par exemple, lorsque vous demandez à une IA de rédiger un blog, elle génère sa réponse en accédant à un ensemble de données, qui contient parfois des centaines de gigaoctets, voire des téraoctets, de texte provenant de diverses sources.

Comment les modèles d'IA sont-ils formés ?

Pour comprendre comment les modèles d'IA sont formés, il est important de noter que les outils d'IA récemment popularisés sont qualifiés d'IA générative (GenAI), notamment :

- ChatGPT-3 et 4 d'OpenAI

- PaLM 2 et Bard de Google

- Le CoPilote de GitHub

La GenAI est une branche de l'IA spécialisée dans la génération de contenu, que ce soit sous forme de texte, d'images, de vidéos ou de code.

Il utilise des algorithmes appelés " grands modèles linguistiques" (LLM) qui ont besoin de grandes quantités de données pour apprendre et se former.

La formation d'un LLM comprend une phase de formation initiale, également appelée phase de préformation, suivie d'un réglage fin du modèle sur des tâches spécifiques ou des domaines d'amélioration. Ces deux phases nécessitent de grandes quantités de données, allant de milliers à des dizaines de milliers d'exemples.

Voyons ce que disent quelques leaders de l'industrie sur la façon dont ils forment leurs outils GenAI.

ChatGPT

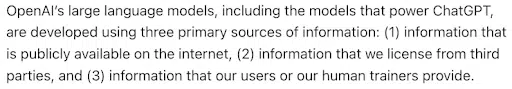

Commençons par ChatGPT, le LLM d'OpenAI, qui énumère les trois catégories suivantes dans sa FAQ :

- Informations accessibles au public

- Informations fournies par des tiers sous licence de l'OpenAI

- Informations fournies par les utilisateurs ou les formateurs humains

Lisez la capture d'écran ci-dessous pour en savoir plus sur la façon dont OpenAI prétend avoir formé ChatGPT.

Techniquement, GPT-3 a été entraîné sur 45 téraoctets de données, tandis que GPT-4, utilisé par ChatGPT Plus, a été estimé à un pétaoctet de données.

Pour vous donner une idée de la quantité d'informations que cela représente, un téraoctet correspond à 500 heures de vidéos HD, et un pétaoctet à 1 000 téraoctets.

Barde

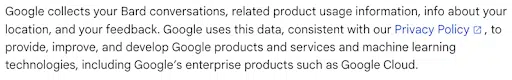

Voyons maintenant comment Bard, le chatbot de Google, a été formé.

Ils citent les sources suivantes :

- Conversations de Bard

- Informations relatives à l'utilisation des produits

- Localisation de l'utilisateur

- Commentaires des utilisateurs

Pour en savoir plus, consultez la capture d'écran ci-dessous de l'avis de confidentialité de Bard.

Je tiens à souligner que Google indique qu'il utilise des données pour entraîner Bard conformément à sa politique de confidentialité, qui mentionne ce qui suit concernant la collecte de données à partir de sources accessibles au public pour l'entraînement de l'IA :

"Par exemple, nous pouvons collecter des informations accessibles au public en ligne ou à partir d'autres sources publiques pour aider à former les modèles d'IA de Google et à créer des produits et des fonctionnalités tels que Google Translate, Bard et les capacités d'IA dans le nuage. Par ailleurs, si les informations relatives à votre entreprise figurent sur un site Web, nous pouvons les indexer et les afficher sur les services Google."

CoPilote

Enfin, lisons comment GitHub utilise les données pour former son programmeur d'IA, CoPilot.

Pour en savoir plus, consultez la capture d'écran ci-dessous, qui provient de la page des fonctionnalités de CoPilot de GitHub.

À l'instar d'OpenAI et de Google, GitHub fait également référence à l'utilisation d'informations accessibles au public comme source d'entraînement à l'IA.

Les différents types de données utilisées pour entraîner l'IA

La GenAI a besoin de grandes quantités de données et utilise différentes sources pour entraîner ces algorithmes - d'abord comme ressource principale pour son développement, puis pour améliorer sa précision et développer ses champs d'application.

D'après les trois exemples que je viens de citer, nous pouvons supposer que les entités utilisent trois grandes catégories de données pour entraîner les modèles d'IA.

Données accessibles au public

La plupart des GenAI utilisent des données publiques à des fins de formation.

Les données accessibles au public sont définies comme toute information accessible au public avec certaines restrictions sur la manière d'y accéder, de l'utiliser et de la distribuer.

Ces restrictions découlent souvent des droits de propriété ou des droits intellectuels sur les données détenus par l'entité qui les rend publiques.

Par exemple, les messages publics de Facebook relèvent de cette définition.

![]()

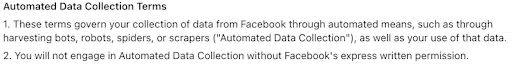

Les messages rendus publics par l'utilisateur sont accessibles à d'autres parties, mais les conditions d'utilisation de Facebook en limitent l'utilisation et la diffusion.

Plus précisément, dans le cas de la formation de modèles d'IA, la collecte automatisée de ces messages est limitée par les conditions de collecte automatisée des données, qui empêchent les parties externes de les collecter sans l'autorisation écrite de Facebook.

Ainsi, bien qu'il existe certaines restrictions, sa disponibilité générale en fait une excellente ressource pour la formation de modèles d'IA.

Il s'agit donc d'une source prédominante pour la phase de pré-entraînement des modèles d'IA, et les sources d'information les plus courantes sont les suivantes :

- Archives du web : Des sites comme Common Crawl parcourent le web pour extraire les données brutes des pages, les métadonnées, les textes et d'autres ressources accessibles, et les archiver. Les ensembles de données de pré-entraînement de GPT-3 comprenaient 60 % du corpus de Common Crawl.

- Le contenu public des médias sociaux : Ces plateformes représentent d'immenses réservoirs de données, donnant un aperçu de millions de comportements et de caractéristiques. Chaque plateforme a des conditions différentes qui limitent les données que des entités externes peuvent collecter, et elles utilisent des données publiques pour entraîner leurs propres modèles d'IA, comme Meta et X/Twitter.

- Dépôts en libre accès: Des sources telles que les dépôts de code publics de Github contiennent des données de recherche provenant d'entités publiques ou privées et offrent un accès gratuit et permanent aux ensembles de données pour que tout le monde puisse les utiliser.

- Les institutions publiques ouvrent des bases de données: Les sites tels que les Archives nationales des États-Unis comprennent généralement des données institutionnelles sur divers sujets, tels que l'économie, l'histoire, les sciences, les sciences humaines, etc.

Données ouvertes et données accessibles au public

Lors de la définition des données publiques, il est également important de mentionner les données ouvertes.

Souvent utilisées de manière interchangeable, les données ouvertes sont une sous-catégorie de données publiques caractérisées par l'absence de restrictions quant à leur accès, leur utilisation et leur distribution.

Certaines des sources les plus importantes de données ouvertes sont les gouvernements, qui disposent de portails de données ouvertes, partageant les données collectées par les institutions publiques.

Les données ouvertes sont généralement soumises à une licence ouverte, bien structurées et lisibles par machine.

Données sur l'utilisation des produits

Les données d'utilisation des produits, générées par les utilisateurs lors de l'utilisation d'un produit, constituent une autre source de données pour l'apprentissage des modèles d'IA.

Comme cela suppose qu'un produit est déjà fonctionnel, cette source de données est utilisée au cours de la phase d'affinement de la formation à l'IA pour fournir des informations sur le comportement et les préférences des utilisateurs.

Vous pouvez classer l'utilisation des produits en deux catégories :

- Données relatives au contenu des utilisateurs : données contenues dans le contenu généré par les utilisateurs lorsqu'ils interagissent avec le produit, notamment les textes, les images, les vidéos, le code, les vidéos générées par l'IA à partir de contenu généré par les utilisateurs (UGC) et toute autre information que l'utilisateur choisit de partager avec le produit.

- Métadonnées: Données générées en relation avec les données de contenu utilisateur, comme dans "données sur les données", et comprenant généralement des détails sur les données de contenu utilisateur, tels que l'heure de création, la source, la taille, l'emplacement, les paramètres de l'appareil, et plus encore.

Cependant, ce type de données étant lié aux utilisateurs, elles sont considérées comme des informations personnelles.

La manière dont un produit collecte et utilise ce type de données est soumise aux lois sur la protection de la vie privée et aux conditions d'utilisation des entreprises.

Données sur les produits sous licence

Comme les données sur l'utilisation des produits, les données sur les produits sous licence sont obtenues par l'intermédiaire de tiers auxquels l'IA est concédée sous licence.

Par le biais d'une licence, une entreprise peut utiliser des modèles d'IA développés et entraînés par une autre entreprise pour les intégrer à ses produits.

C'est ainsi, par exemple, que Microsoft a obtenu une licence pour utiliser la technologie Chat GPT-3 d'OpenAI pour son produit.

Cependant, il est difficile de savoir exactement dans quelle mesure les données d'utilisation des produits sont collectées par OpenAI pour améliorer son modèle d'IA.

Le mot d'un expert

Interrogée sur les conséquences de l'IA sur la confidentialité des données pour les entreprises et les consommateurs, Anupa Rongala, PDG d'Invensis Technologies, a déclaré : "L'IA a transformé la confidentialité des données en rendant la sécurité plus intelligente, mais aussi plus vulnérable."

Elle a ajouté : "Les entreprises analysent désormais de vastes ensembles de données en temps réel, détectant les menaces plus rapidement que jamais. Dans le même temps, l'automatisation pilotée par l'IA augmente les risques, car les algorithmes collectent, traitent et déduisent souvent des informations sensibles sans le consentement clair de l'utilisateur."

"Les entreprises qui adoptent l'IA responsable vont non seulement se conformer aux réglementations, mais aussi instaurer une confiance à long terme." Anupa Rongala, PDG, Invensis Technologies

Pour elle, les plus grands défis comprennent "les biais, l'accès non autorisé aux données et la dépendance excessive à l'égard des prises de décision basées sur l'IA."

"Il est possible de trouver un équilibre - une gouvernance claire, une surveillance humaine et des pratiques éthiques en matière d'IA ne sont pas négociables.

La formation à l'IA à l'aide de données publiques est-elle autorisée par les lois sur la protection de la vie privée ?

De toutes les sources utilisées pour l'entraînement des modèles d'IA, les données accessibles au public constituent la principale ressource, d'abord en raison de leur disponibilité, mais aussi parce qu'il n'existe que peu ou pas de restrictions en matière d'accès, d'utilisation et de distribution.

Par conséquent, l'ampleur et la fréquence de la collecte de données accessibles au public ont augmenté depuis l'apparition des outils de GenAI.

D'un point de vue réglementaire, les données accessibles au public - dans la mesure où elles sont considérées comme des informations personnelles - sont moins réglementées par les lois sur la protection de la vie privée que les informations personnelles non publiques.

La dimension "publique" suggère qu'à un moment donné, l'individu à qui elle appartient l'a rendue publique, renonçant ainsi à ses attentes en matière de respect de la vie privée.

Dans cette section, je me concentrerai sur les lois européennes et américaines relatives à la protection de la vie privée et j'expliquerai comment elles définissent les données personnelles accessibles au public et ce qu'elles exigent pour une collecte légale.

Lois sur la protection de la vie privée dans l'UE

Dans l'UE, le RGPD ne définit pas les données personnelles accessibles au public, ce qui signifie qu'il n'y a pas de distinction entre les données accessibles au public et les données personnelles.

Le RGPD s'applique à toutes les données à caractère personnel, quelle que soit leur source.

Par conséquent, les exigences de notification pour les responsables du traitement énoncées à l'article 14 concernant la collecte d'informations auprès de sources autres que la personne concernée elle-même s'appliquent à la collecte de données publiques en vertu du RGPD.

Notamment, une finalité et une base légale sont nécessaires pour traiter ces données à caractère personnel.

Ce que dit le RGPD à propos des données publiques

Bien que le RGPD ne définisse pas les données publiques, il les mentionne et exige des responsables du traitement qu'ils indiquent si les données proviennent de sources accessibles au public ( article 14).

En outre, l 'article 9 fixe des règles applicables à des catégories particulières de données à caractère personnel et semble limiter les exigences en ce qui concerne les données accessibles au public.

Si le traitement porte sur des données à caractère personnel manifestement rendues publiques par la personne concernée, aucun consentement explicite ni aucune autre base juridique telle qu'énumérée à l'article 9 (principalement des lois et règlements spécifiques ou la constatation, l'exercice ou la défense d'un droit en justice) n'est requis.

Ainsi, lorsqu'il s'agit d'entraîner des modèles d'IA sur des données personnelles accessibles au public dans le cadre du RGPD, nous pouvons déduire qu'une entreprise devra suivre plusieurs étapes :

- Première étape : choisir une base légale pour l'entraînement de modèles d'IA à l'aide de données accessibles au public. Qu'il s'agisse d'un consentement, d'un contrat, d'un intérêt légitime ou d'une obligation légale, il convient de choisir une base juridique et de mettre en œuvre ses exigences conformément aux dispositions de l'article 6.

- Deuxième étape : informez les personnes concernées que leurs données personnelles accessibles au public ont été traitées pour former des modèles d'IA, conformément à l'article 14, par exemple en mettant à jour votre politique de confidentialité afin d'indiquer clairement cette utilisation.

- Troisième étape : Former des modèles d'IA sur des catégories particulières de données à caractère personnel (données révélant l'origine raciale ou ethnique, les opinions politiques, les convictions religieuses ou philosophiques, etc.) conformément aux exigences de l'article 9, c'est-à-dire uniquement les données manifestement rendues publiques par les personnes concernées ou lorsque la personne concernée donne son consentement explicite, et qu'aucune autre loi ne s'y oppose.

Dans ce contexte, il est intéressant de noter que l'UE a commencé à agir spécifiquement sur la formation des modèles d'IA.

En mars 2023, l'autorité italienne de protection des données, la Garante, a publié une ordonnance d'exécution à l'encontre d'OpenAI.

Parmi les nombreuses constatations de non-conformité concernant le ChatGPT, l'une des principales critiques était que l'OpenAI ne disposait pas d'une base juridique en vertu de l'article 6 RGPD pour traiter les données à caractère personnel en vue de l'entraînement initial des algorithmes.

De même, en octobre 2022, la CNIL française a adressé une injonction à Clearview AI et lui a infligé une amende.

Parmi les nombreuses violations du RGPD , les pratiques de Clearview AI en matière d'exploration du web pour former son logiciel de reconnaissance faciale ont été explicitement jugées contraires aux obligations de l'article 6 en matière de base légale.

La loi européenne sur l'IA

L'Europe est désormais à la pointe de la réglementation en matière d'IA après l'adoption par le Parlement de la loi européenne sur l'IA.

L'année dernière, je me suis entretenu avec Anokhy Desai, avocat spécialisé dans la protection de la vie privée, qui avait alors déclaré : "Tous les regards sont tournés vers la loi européenne sur l'IA, qui est en cours d'élaboration depuis quelques années. Elle devrait être adoptée au début de l'année prochaine, ce qui signifie qu'elle devrait entrer en vigueur à la fin de 2025 ou au début de 2026."

"Tous les regards sont tournés vers la loi européenne sur l'IA". Anokhy Desai, avocat spécialisé dans la protection de la vie privée | CIPP/US, CIPT, CIPM, CIPP/C, CIPP/E, FIP

Aujourd'hui partiellement en vigueur, la loi décrit principalement les exigences de transparence pour la GenAI et classe la technologie selon différents niveaux de risque.

Desai ajoute : "La loi sur l'IA elle-même adopte une approche basée sur le risque pour réglementer l'IA, et une disposition récente ajoutée à la loi sur l'IA exigerait que "les entreprises déployant des outils d'IA générative, tels que ChatGPT... divulguent tout matériel protégé par le droit d'auteur utilisé pour développer leurs systèmes".

Toutefois, la loi européenne sur l'IA ne précise pas quelles informations peuvent être utilisées à des fins de formation.

"On ne sait pas encore si de futurs amendements, exclusions ou règles définiront les types acceptables de données accessibles au public", précise M. Desai, "par nature, ces données sont publiques et ne sont donc pas rétroactivement protégées".

Lois sur la protection de la vie privée aux États-Unis

Aux États-Unis, certains États ont adopté une approche différente en ce qui concerne les données accessibles au public, à l'opposé des réglementations de l'UE.

Selon M. Desai, "parmi les lois nationales sur la protection de la vie privée qui sont entrées en vigueur cette année, quelques-unes contiennent des dispositions relatives à l'IA, comme les limites imposées par l'ACPR à la conservation des données, au partage des données et à l'utilisation d'informations personnelles sensibles par l'IA".

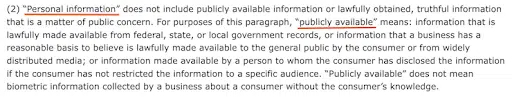

Cependant, les lois des États suivants ont exclu les données accessibles au public de la définition des informations personnelles et, par conséquent, de l'application et du champ d'application de ces lois :

- Loi californienne sur la protection de la vie privée des consommateurs (CCPA)

- Loi sur la protection des données des consommateurs de Virginie (VCDPA)

- Loi du Colorado sur la protection de la vie privée (CPA)

Prenons l'exemple de la loi sur la protection des données, telle qu'elle a été modifiée par l'ACPR, et lisons ci-dessous les définitions des termes "informations à caractère personnel" et "accessible au public".

Par conséquent, les données accessibles au public ne tombent pas sous le coup de l'obligation de notification prévue par la CCPA, ni sous le coup des droits des consommateurs à la suppression et à l'exclusion des ventes et du partage.

"Bien qu'aucune de ces lois ne mentionne l'utilisation de données accessibles au public pour l'entraînement de modèles d'IA, précise M. Desai, l'augmentation exponentielle du nombre de propositions de lois sur l'IA laisse présager qu'un tel projet de loi pourrait être proposé à l'avenir.

Le manque de protection des données publiques peut expliquer les récentes controverses concernant certaines entreprises qui utilisent ces informations pour former des modèles d'IA sans obtenir de consentement ou d'autre base légale.

Par exemple, en août 2023, Zoom a été au centre d'une controverse en raison des clauses de ses conditions de service relatives à l'utilisation d'informations personnelles pour former des modèles d'apprentissage automatique et d'IA.

De même, OpenAI, Microsoft et Google font l'objet de recours collectifs aux États-Unis pour leurs pratiques de récupération de données à des fins de formation de modèles d'IA.

Les plateformes de médias sociaux peuvent-elles utiliser vos données pour former l'IA ?

Comme nous l'avons vu, les médias sociaux constituent un immense réservoir de données - publiques ou non - et peuvent constituer une ressource pour l'entraînement des modèles d'IA.

En règle générale, le caractère public ou privé des données dépend des paramètres de confidentialité choisis par l'utilisateur sur la plateforme qu'il utilise.

Les différentes plateformes ont des champs d'application uniques en ce qui concerne ce qui peut être rendu public et des approches différentes quant à la manière dont les autres peuvent utiliser ces données pour former des modèles d'IA.

Dans la section suivante, nous aborderons brièvement quelques-unes des plateformes les plus populaires.

Facebook et Instagram

Facebook et Instagram relèvent du champ d'application des politiques de Meta en matière de données publiques.

Tout d'abord, oui, les deux plateformes utilisent des données publiques disponibles sur leur plateforme pour entraîner l'IA de Meta, comme l'a récemment indiqué Nick Clegg, président des affaires mondiales de Meta.

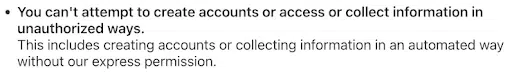

En ce qui concerne la collecte de données publiques par des parties externes pour l'entraînement de modèles d'IA, les conditions d'utilisation des deux plateformes ne l'autorisent pas sans leur permission expresse - dont on peut supposer qu'elles ne l'accordent pas à leurs concurrents.

Vous trouverez ci-dessous les conditions de collecte de données de Facebook.

Dans la capture d'écran suivante, vous pouvez lire les conditions d'utilisation d'Instagram.

X/Twitter

Comme Meta, les termes de X (anciennement Twitter) mentionnent l'utilisation de données accessibles au public pour entraîner les modèles d'apprentissage automatique de l'entreprise, comme le rapporte Techcrunch.

En outre, lors du lancement de xAI, Elon Musk a déclaré qu'il utiliserait les tweets publics pour entraîner sa nouvelle IA.

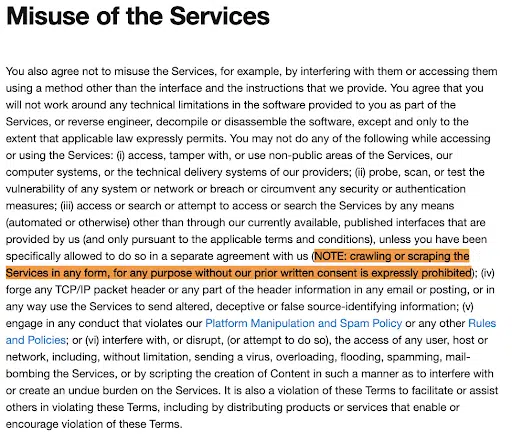

En ce qui concerne l'accès des tiers aux données publiques de la plateforme, X a spécifiquement mis à jour ses conditions pour interdire tout crawling ou scraping afin d'empêcher l'apprentissage de l'IA.

Vous pouvez voir ces termes dans la capture d'écran ci-dessous.

Résumé

La formation de modèles d'IA a récemment suscité beaucoup d'inquiétudes en raison de son immense appétit pour les données - y compris les données personnelles.

Cependant, l'exploitation d'informations accessibles au public est devenue la norme pour les développeurs d'IA, car les lois sur la protection de la vie privée sont plus souples en ce qui concerne ce type de données.

Cependant, des événements récents indiquent que les régulateurs, le public et les entreprises d'IA doivent encore trouver un terrain d'entente pour développer des pratiques de formation à l'IA plus dignes de confiance, notamment :

- Sanction de Clearview AI pour collecte illégale d'images publiques

- Les recours collectifs contre les grands acteurs de l'IA

- Réaction négative du public aux conditions d'utilisation du site Zoomà l'été 2023

Un premier pas vers cette confiance pourrait être la ratification et la mise en œuvre de l'Acte sur l'IA de l'UE, que les institutions européennes ont finalisé en 2024.

Quoi qu'il en soit, les données personnelles doivent rester protégées conformément aux lois applicables, et nous devons continuer à nous informer sur les données publiques et la manière dont elles sont utilisées.